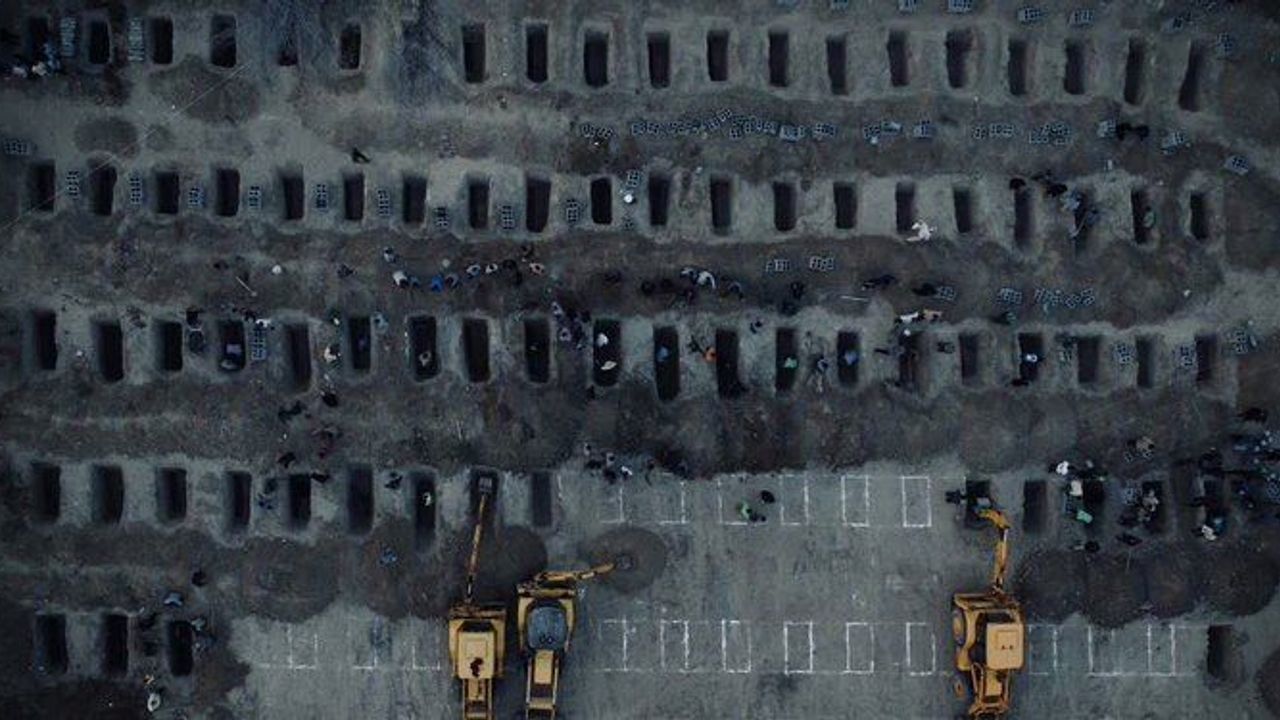

Yeni kazılmış mezarlar, 20'şerli düzenli sıralar halinde dizilmiş durumda. 60'tan fazla mezar çoktan topraktan çıkarılmış ve etraflarında birkaç insan kümesi toplanmış. Ön taraftaki zeminde de onlarca mezar daha işaretlenmiş: küçük tebeşir dikdörtgenleri ve kazıcılar görevlerini tamamlamak için hazır bekliyor.

Minab kasabasının 100'den fazla genç kızının defnedilmesine hazırlanırken fotoğraflanan mezarlık, ABD-İsrail'in İran'a karşı yürüttüğü savaşın en belirleyici görüntülerinden biri olup, yıkıcı sivil kayıpları açıkça gözler önüne seriyor.

Ama bu gerçek mi?

The Guardian'dan Tess McClure'un yazısına göre, Google tarafından desteklenen yapay zeka hizmeti Gemini'ye sorarsanız alacağınız cevap hayır olacaktır; hatta Gemini , fotoğrafın iki yıl öncesine ve 2.000 km'den (1.240 mil) fazla uzak bir yere ait olduğunu iddia ediyor. Görüntü, füzeyle öldürülen küçük kız çocuklarının mezarları yerine, 2023'te meydana gelen 7,8 büyüklüğündeki depremin ardından "Türkiye'nin Kahramanmaraş kentindeki toplu bir mezarlık alanını" gösteriyor. Gemini, "Bu özel havadan görünüm, felaketin en çok paylaşılan görüntülerinden biri haline geldi ve kayıpların muazzam boyutunu gösterdi" diyor.

Aynı defin fotoğrafını sosyal medyada gören diğerleri, doğruluğunu kontrol etmek için X'in yapay zekâ asistanı Grok'a başvurdu. Gemini gibi Grok da fotoğrafın İran'dan olmadığını rahatlıkla teyit ediyor; ancak farklı bir tarih, felaket ve konumda yer alıyor. Fotoğrafın "Endonezya'nın Jakarta şehrindeki Rorotan Mezarlığı'ndan, Temmuz 2021 tarihli, Covid toplu definlerine ait bir stok fotoğrafı. Minab değil," diyor.

Her iki durumda da yapay zekânın cevapları kesin gibi görünüyor: tereddüt etmiyorlar ve hatta kontrol etmek isterseniz orijinal görüntünün "kaynaklarını" bile sunuyorlar. Ancak, bu kaynakları incelemek için konuyu takip ederseniz, çıkmaz sokaklara girmeye başlayacaksınız: ya görüntü hiç görünmüyor ya da verilen bağlantı var olmayan bir haber raporuna yönlendiriyor. Tüm netlik ve kesinlik izlenimlerine rağmen, yapay zekâlar basitçe yanılıyor.

Mezarlık görüntüsünün gerçek olduğu ortaya çıktı. Araştırmacılar, yerin fotoğrafını konumunu doğrulayan uydu görüntüleriyle karşılaştırdı ve aynı yerin biraz farklı açılardan çekilmiş düzinelerce görüntüsüyle ve video kayıtlarıyla tekrar karşılaştırabildi; uzmanlar bunların hiçbirinde tahrifat veya dijital manipülasyon belirtisi olmadığını söylüyor. Gemini ve Grok'un "gerçek kontrolü" çalışmaları, İran savaşıyla ilgili haberleri saran yapay zeka tarafından üretilen saçmalıkların - hayali gerçekler, anlamsız analizler ve sahte görüntüler - sadece bir örneği. Uzmanlar, bunun soruşturma zamanını boşa harcadığını ve vahşetlerin inkar edilme riskini taşıdığını, ayrıca insanların haber ve bilgi için giderek daha fazla yapay zeka özetlerine güvenmesiyle birlikte endişe verici zayıflıkların habercisi olduğunu söylüyor.

BBC Verify ekibinde kıdemli gazeteci olan ve bilgileri doğrulamak ve görsel araştırmalar yapmak için adli teknikler kullanan Shayan Sardarizadeh, "Bana dikkat çeken sahte görüntülerden biri, potansiyel bir suikastten kaçınmak için Tahran'da kadın kılığına girmiş üst düzey bir İranlı komutanı gösterdiğini iddia ediyordu" diyor. "Sokak, arka plandaki bina ve çevre, Tahran'da gerçekçi bir sahne gibi görünüyordu."

Sardarizadeh, ekibin çürüttüğü tüm yanlış bilgilerin büyük bir kısmının artık yapay zekâ tarafından oluşturulduğunu ve bu oranın giderek arttığını söylüyor. Örneğin, Gazze veya Ukrayna savaşlarının ilk birkaç haftasında, ekibin gördüğü sahte gönderilerin çoğu eski veya ilgisiz videolar ya da yeniden kullanılan video oyunu görüntüleriydi. Şimdi ise, "takip ettiğimiz ve çürüttüğümüz viral yanlış bilgilerin neredeyse yarısı, hatta daha fazlası, üretken yapay zekâ tarafından üretiliyor."

Bu durum kısmen, herkesin artık gerçekçi bir video veya fotoğraf oluşturmasının kolaylığından kaynaklanıyor. Ancak diğer büyük değişim, insanların doğrudan orijinal kaynağa gitmek yerine, haberleri özetlemek veya soruları yanıtlamak için yapay zekayı kullanmalarıdır. Google yapay zeka özetleri ve Grok, 2024 ortalarında daha geniş uluslararası kamuoyuna sunuldu ve hızla yaygınlaştı: İnsanların %65'i düzenli olarak haberlerin veya diğer bilgilerin yapay zeka özetlerini gördüğünü bildiriyor ve bilgi edinmek için üretken yapay zekayı kullandığını söyleyenlerin oranı geçen yıl ikiye katlandı . Ancak çoğu zaman yapay zeka özetleri yanlıştır. 2025'te yapılan uluslararası bir çalışma, yapay zeka tarafından oluşturulan özetlerin yaklaşık yarısının en az bir önemli kaynak veya doğruluk sorununa sahip olduğunu ortaya koydu; Google'ın popüler Gemini arayüzü gibi bazı araçlarda bu oran %76'ya kadar çıktı.

İran savaşı örneğinde, doğruluk kontrolü yapanlar bu tür yanıltıcı materyallerin çok fazla olduğunu söylüyorlar. Minab mezarlığı görüntülerinin yanı sıra, Grok'un X kullanıcılarına Tahran'daki yangınların video görüntülerinin aslında 2017'de Los Angeles'tan olduğunu yanlış bir şekilde öne sürmesi ve kullanıcıların Minab okulunun yanına düşen bir füzenin görüntüsünü yanlış tanımlamak için "yapay zeka analizi"ne atıfta bulunması (çok sayıda mühimmat uzmanı bunun bir ABD Tomahawk füzesi olduğunu söylüyor; bu bulgu, olay yerinde bulunduğu bildirilen parçalar ve bombalama hakkındaki ABD iç brifingleriyle de destekleniyor) gibi örnekler de mevcut.

Sardarizadeh, "Gerçekleri kontrol edenler artık düzenli olarak hem yanlış bir gönderiyi hem de o gönderiyle ilgili olarak bir sohbet robotu tarafından yapılan yanıltıcı bir iddiayı ele almak zorunda kalıyorlar" diyor.

Sorunun bir kısmı, LLM yapay zeka modellerinin (Grok, ChatGPT ve Gemini gibi) çalışma şeklinden kaynaklanıyor. Çok temel bir düzeyde, bunlar olasılıksal dil modelleridir ve hangi sonraki kelimenin en uygun olma olasılığına sahip olduğuna bağlı olarak cümleleri parça parça oluştururlar. Bu süreç ikna edici, otoriter tınlayan cümleler üretse de, yapay zekanın önündeki materyali gerçekten analiz ettiği anlamına gelmez.

Açık kaynak istihbarat analisti ve medya okuryazarlığı eğitimcisi Tal Hagin, “Yapay zeka, her şeye erişimi olan ancak duygusuz, her şeyi bilen bir varlık olarak algılanıyor,” diyor; bu nedenle insanlar ona güvenme eğiliminde. “Aslında kullandığınız şey, bir gerçek kutusu değil, çok gelişmiş bir olasılık makinesi.”

Sorun, yapay zekanın bulgularını sunma biçimindeki otoriter tavırla daha da karmaşıklaşıyor. İsimler ve tarihler, referanslar ve kaynaklar da dahil olmak üzere ayrıntılı "raporlar" üretiyor; bu tür materyaller derinlemesine araştırma ve anlayış izlenimi veriyor, ancak aslında hayal ürünü veya mevcut olmayan bilgiler olabilir.

"Gözden kaçırdığım için özür dilerim. Görüntüyü tekrar inceledikten sonra... "

Guardian, Gemini'nin Minab fotoğrafıyla ilgili cevabını sorgulayarak, "Bunun doğru olduğunu düşünmüyorum, tekrar arama yapabilir misiniz?" dediğinde, yapay zeka bulgusunu düzeltti - ancak yine yanlış bir konum ve yıl şeklinde. "Gözden kaçırdığım için özür dilerim. Görüntüyü tekrar inceledikten sonra... bu görüntü Kasım 2023'te Gazze'de çekildi," diyor. Bu cevabın da yanlış olduğu ve fotoğrafın İran'dan olduğu söylendiğinde, bot tekrar düzeltti - Covid pandemisi sırasında Tahran'dan olduğunu söyledi. Fotoğrafın 2025'te İran'da çekildiği söylendiğinde ise, güney İran'daki bir depremin ardından olduğunu belirtti.

İnsan hakları ihlallerini araştıranlar için bu eğilim yeni zorluklar ortaya koyuyor. İran'da sivillerin hayatını kaybettiği bir dizi bombalama olayını araştıran bağımsız açık kaynak araştırmacısı Chris Osieck, araştırmacıların zamanının yapay zekâ materyallerini çürütmekle harcandığını söyledi. Örneğin, yapay zekâ videolarını çürütmek genellikle görsel tutarsızlıklar için kare kare dikkatlice incelemeyi içeriyor. "Bu zaman en önemli şeye ayrılmalı: bu acımasız savaşın çatışmanın ortasında kalan insanlar üzerindeki etkisini raporlamaya."

Peki ya Minab gibi, kanıtlanabilir şekilde gerçek olan vakalarda? Araştırmacılar, yapay zekâ tarafından üretilen bu saçmalıkların, insanların zihninde, kanıtlarını gördükleri vahşetin gerçekten yaşanıp yaşanmadığı konusunda şüphe uyandırdığından endişe ediyor. Sardarizadeh, "Teknoloji gelişmeye devam ettikçe, gerçek vahşetlere ait video ve görüntüler sahte veya yapay zekâ ürünü olarak reddedilecek kadar kafa karışıklığı yaratabilir" diyor.

"Bunun örneklerini Gazze ve Ukrayna'daki çatışmalarla ilgili olarak zaten gördüm," diyor.

Sevdiklerini kaybedenler için, hesap verebilirlik, yanlış bilgiler, şüphe ve güvensizlik yığını tarafından gölgede bırakılma riski taşır.

Osieck, “Sonuç olarak, bunun hayatını kaybedenlerin ailelerinin bakış açısından nasıl göründüğünü de düşünmek gerekiyor,” diyor. “Bir çocuğu kaybettiğinizi ve ardından yapay zekanın internette olayın yaşanmadığını iddia etmek için kullanıldığını hayal edin. Bu sadece araştırmacılar için bir engel değil. Aynı zamanda yas tutan sevdiklerine karşı da son derece saygısızca bir davranış.”