Eski askerlerden oluşan İsrail insan hakları örgütü Breaking the Silence'ın eski genel müdürü olan Oxford Üniversitesi Blavatnik Kamu Yönetimi Okulu'nda doktora araştırmacısı Avner Gvaryahu, yapay zeka şirketlerinin savaşlarla ilişkisini ele aldığı The Guardian'da yayımlanan yazısında, çarpıcı tespitlere yer veriyor.

İşte o yazı:

İsrail ordusunun "sis prosedürü" adı verilen bir stratejisi var. İlk olarak İkinci İntifada sırasında kullanılan bu gayri resmi kural, düşük görüş koşullarında askeri mevzileri koruyan askerlerin, görünmez bir tehdidin pusuda bekliyor olabileceği düşüncesiyle karanlığa doğru ateş açmasını gerektiriyor.

Bu, körlüğün meşru kıldığı bir şiddet. Karanlığa ateş edin ve buna caydırıcılık deyin. Yapay zekâ savaşının doğuşuyla birlikte, bu seçilmiş körlük mantığı rafine edildi, sistemleştirildi ve bir makineye devredildi.

İsrail'in Gazze'deki son savaşı , ilk büyük "yapay zeka savaşı" olarak nitelendirildi; yani yapay zeka sistemlerinin, İsrail'in hedef alacağı Hamas ve İslami cihat militanlarının listesini oluşturmada merkezi bir rol oynadığı ilk savaş. Bu sistemler, bölgedeki herhangi bir kişinin savaşçı olma olasılığını sıralamak için milyarlarca veri noktasını işledi.

Gözetleme kulesindeki karanlık, arazinin bir koşuluydu. Algoritmanın içindeki karanlık ise tasarımın bir koşuludur. Her iki durumda da körlük seçilmiştir. Körlük yararlı olduğu için seçilmiştir: inkar edilebilirlik yaratır, şiddetin kaçınılmaz hissettirmesini sağlar, kararı kimin verdiği sorusunu kişiden bir prosedüre taşır. Sis dağılmadı. Bir olasılık puanı verildi ve zeka olarak adlandırıldı.

ABD-İsrail-İran savaşının başlangıcında , İran'ın güneyindeki Minab şehrinde bulunan Şahereh Tayyebeh ilkokuluna yapılan saldırıya yol açan şeyin, bilinçli bir körlük olabileceği düşünülüyor. Saldırıda çoğu 7 ila 12 yaş arası kız çocuk olmak üzere en az 168 kişi hayatını kaybetti.

Silahlar isabetliydi. Mühimmat uzmanları hedeflemeyi "inanılmaz derecede doğru" olarak tanımladı ; her bina ayrı ayrı vuruldu, hiçbir şey ıskalanmadı. Sorun uygulama değildi. Sorun istihbarattı. Okul, yaklaşık on yıl önce bitişiğindeki Devrim Muhafızları üssünden bir çitle ayrılmış ve sivil kullanım için yeniden düzenlenmişti. Hedefleme döngüsünün bir yerinde, bu gerçek hiçbir zaman güncellenmemiş gibi görünüyor.

Minab saldırısındaki yapay zekanın kesin rolü resmi olarak doğrulanmadı. Bilinen şey, bu sistemlerin çalıştığı hedefleme altyapısının, temel istihbaratın on yıl öncesine ait olduğunu tespit edecek güvenilir bir mekanizmaya sahip olmamasıdır.

Bu okulun bir algoritma tarafından seçilip seçilmemesine bakılmaksızın, algoritmik hedefleme tarafından oluşturulan bir sistem tarafından seçilmiştir. İran'daki harekatın ilk 24 saatinde 1.000 hedefi vurmak için ABD ordusu, hedef listesini insan ekibinin asla taklit edemeyeceği bir hızda oluşturmak, önceliklendirmek ve sıralamak için yapay zeka sistemlerine güvendi.

Gazze bir laboratuvardı. Minab ise pazar. Sonuç olarak, modern savaşta en önemli hedef belirleme kararlarının, kendilerini açıklayamayan sistemler tarafından, kimseye hesap vermeyen şirketler tarafından tedarik edilerek, hesap verebilirliğin ve sorgulamanın olmadığı çatışmalarda alındığı bir dünya ortaya çıktı. Bu, sistemin başarısızlığı değil, sistemin kendisidir.

Çocukların kabul edilebilir hata oranlarına sahip olmasını sağlayan mantık için yalnızca algoritmayı suçlama cazibesine direnmeliyiz. Temmuz 2014'te, Bakr ailesinden dört çocuk – İsmail, Zekeriya, Ahed ve Muhammed, yaşları 9 ile 11 arasında – Gazze'deki bir plajda öldürüldü . Hiçbir yapay zeka işin içinde değildi. Bölge önceden Hamas'ın deniz üssü olarak sınıflandırılmıştı. Çocuklar, koşup sonra yürüdükleri için şüpheli olarak işaretlenmişti – bu davranış, dikkat çekmemeye çalışan savaşçılar için bir hedefleme şablonuna uyuyordu. İlk füze isabet ettiğinde, hayatta kalan çocuklar kaçtı. Drone onları takip etti ve tekrar ateş etti. Bir subay daha sonra, dikey bir hava görüntüsünden çocukları tespit etmenin çok zor olduğunu ifade etti. Saldırı, hedefleme hatası olarak kaydedildi.

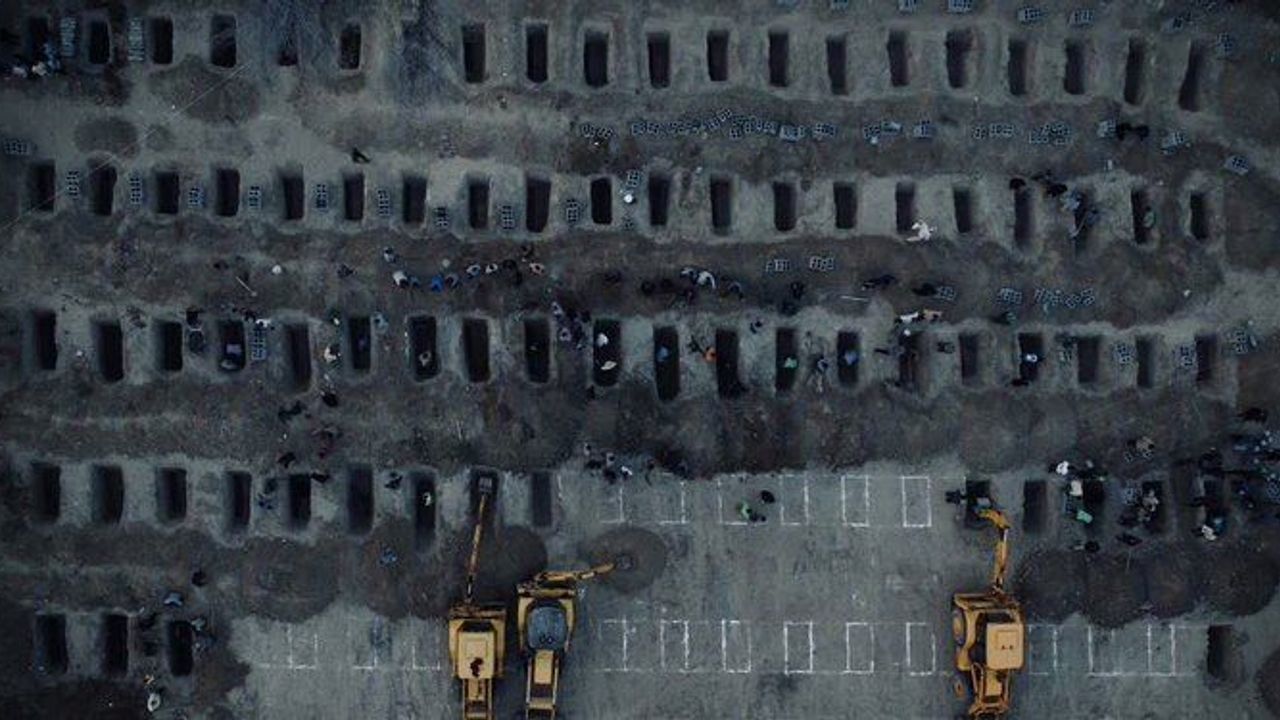

Guardian, +972 Dergisi ve Local Call tarafından incelenen gizli bir İsrail askeri veri tabanı, Gazze'de kaydedilen 53.000'den fazla ölümün yaklaşık %17'sinin Hamas ve İslami Cihad savaşçıları olduğunu gösteriyor. Bu da geri kalan %83'ünün siviller olduğunu düşündürüyor. Bunlar, hassasiyetle yürütülen bir savaşın istatistikleri değil; bu, belirsizliğin amaçlandığı bir savaş. (İsrail Savunma Kuvvetleri, Guardian makalesinde sunulan rakamları reddetti, ancak hangi rakamlar olduğunu belirtmedi.)

Yani yapay zekâ hedefleme sistemleri bu mantığı icat etmedi. Onu miras aldılar, milyonlarca veri noktasına kodladılar ve anlamlı bir insan kontrolünün ötesinde otomatikleştirdiler. Minab'daki bir okulun bir veritabanında askeri yerleşke olarak sınıflandırılması bir arıza değildir. Bu, sis prosedürüdür, Gazze'de dört çocuğu bir plajda kovalayan aynı mantıktır – farklı bir ölçekte, farklı bir ülkede, farklı bir silahla, tam olarak tasarlandığı gibi çalışır. Karanlığın artık daha iyi donanımı var.

Bu yapay zekâ sistemlerinin çoğu, uluslararası insancıl hukuka aykırıdır; zira insancıl hukuk, askeri operasyonlardan yalnızca doğru sonuçlar talep etmekle kalmaz, aynı zamanda operasyonlar gerçekleştirilmeden önce dikkatli bir süreç de gerektirir. Bir komutan, hedefin meşru bir askeri hedef olduğunu doğrulamak için her türlü makul çabayı göstermelidir. Hukuk ayrıca, sivilleri saldırının etkilerinden korumak için mümkün olan her şeyin yapılmasını, sonradan akla gelen bir şey olarak değil, paralel ve eşit bir yükümlülük olarak gerektirir.

Bu yükümlülük, mantığı şeffaf olmayan ve çıktıları gerçek zamanlı olarak sorgulanamayan bir sisteme devredilemez. Gazze'de, bir algoritma şeritteki her kişi hakkında verileri (telefon kayıtları, hareket kalıpları, sosyal bağlantılar, davranışsal sinyaller) işledi ve her birine savaşçı olma olasılığını gösteren bir olasılık puanı atayarak sıralı bir isim listesi oluşturdu. Bu, bir insan analistin bilinen bir militanı tespit edip onu vurmak için bir silah programlamasıyla aynı şey değildir. Yapay zeka kimlikleri doğrulamıyordu. İstatistiksel olarak, tüm bir nüfus genelinde çıkarımlar yapıyor ve listede görünmeden önce hiçbir insanın bireysel olarak değerlendirmediği hedefler oluşturuyordu.

Bu sistemde doğrulama, bir insan operatörün her ismi ortalama 20 saniye boyunca incelemesi anlamına geliyordu; bu süre, hedefin erkek olduğunu doğrulamak için yeterliydi. Ardından onay veriyorlardı. Savaşın ilk haftalarında tek bir sistem 37 binden fazla hedef üretti. Bir diğeri ise günde 100 potansiyel bombalama alanı üretebiliyordu. Sistemdeki insanlar karar verme yetkisini kullanmıyorlardı. Bir kuyruğu yönetiyorlardı.

İran'daki durum şu an için daha az belgelenmiş durumda. Ancak ölçek kendi başına bir hikaye anlatıyor. İki kaynak NBC News'e , kısmen büyük dil modeli teknolojisinden yararlanan Palantir'in yapay zeka sistemlerinin hedefleri belirlemek için kullanıldığını doğruladı. (Palantir CEO'su Alex Karp, CNBC'de bu konuda sorulduğunda "ayrıntılara giremeyeceğini" söyledi, ancak Claude'un hala İran savaşında kullanılan Palantir sistemlerine entegre olduğunu belirtti.) ABD Merkez Komutanlığı Başkanı Brad Cooper, ordunun İran'da yapay zekayı "saniyeler içinde çok miktarda veriyi taramak" ve "düşmanın tepki vermesinden daha hızlı, daha akıllı kararlar almak" için kullandığını övünerek dile getirdi. Her saldırının yapay zeka destekli olup olmadığına bakılmaksızın, kampanyanın temposu ancak hedeflemenin büyük ölçüde otomatikleştirilmesi sayesinde mümkün oldu.

Yapay zekâ destekli hedeflerin doğrulama süreleri saniyelerle ölçüldüğünde, artık algoritmik yardımla insan yargısından bahsetmiyoruz. Bir makinenin çıktısının onaylanmasından bahsediyoruz. Ve bu makinenin verileri on yıl öncesine ait olduğunda, sonuçlar küçük tabut sıraları halinde yazılmış gibi oluyor.

CIA'nın erken dönem fonlarıyla kurulan ve şu anda ABD ordusunun başlıca yapay zeka altyapı sağlayıcılarından biri olan Palantir...

Bu olayda adı geçen şirketler, sıradan savunma girişimleri değil. CIA'nın erken dönem fonlarıyla kurulan ve şu anda ABD ordusunun başlıca yapay zeka altyapı sağlayıcılarından biri olan Palantir, İran harekatında kullanılan sistemleri tedarik etti. Bu sistemler kısmen, ana şirketi Pentagon'un hedefleme amacıyla kullanımına ilişkin etik kısıtlamaları kaldırma baskısına direnmeye çalışan büyük bir dil modeli olan Anthropic'in Claude'undan yararlanıyor. Pentagon, bağları koparmakla tehdit ederek karşılık verdi ve bunun yerine OpenAI ve diğerlerine yöneldi. Büyük ölçekte öldürme pazarı, tedarikçi sıkıntısı çekmiyor.

Bu olay öğretici nitelikte: Sınır çizmeye çalışan tek şirket devre dışı bırakıldı ve katliam kesintisiz devam etti. Google, önemli iç çalışan protestolarına rağmen, İsrail hükümeti ve ordusuyla 1 milyar dolardan fazla değerinde bir bulut bilişim ve yapay zeka sözleşmesi olan Nimbus Projesi'ni imzaladı.

Amazon, Google ile birlikte Nimbus Projesi'nin ortak imzacısıdır. Microsoft, 2024 yılında baskı altında kısmen geri çekilmeden önce İsrail askeri sistemleriyle derin bir entegrasyona sahipti ve bu noktadan sonra veriler birkaç gün içinde Amazon Web Services'e taşındı.

Palmer Luckey tarafından kurulan ve büyük ölçüde eski ABD savunma yetkililerinden oluşan Anduril, özellikle ölümcül hedefleme için tasarlanmış otonom silah sistemleri üretiyor. Yakın zamana kadar hizmet şartlarında askeri kullanımı yasaklayan OpenAI, 2024 yılının başlarında bu kısıtlamayı sessizce kaldırdı ve o zamandan beri Pentagon sözleşmeleri peşinde koşuyor. Bunlar, yüz milyonlarca insan tarafından kullanılan tüketici ürünleri, üniversite araştırma ortaklıkları ve Washington, Brüksel ve ötesinde önemli siyasi nüfuzlarıyla dünyanın en değerli şirketleri arasında yer alıyor.

Elbette özel şirketler yüzyıllardır ordulara telsizler, kamyonlar, uydu navigasyon sistemleri, mikrodalga teknolojisi ve elbette karmaşık silah sistemleri tedarik ediyor. Bu yeni veya doğası gereği yozlaşmış bir durum değil. "Çift kullanımlı" sorun, sanayileşme kadar eskidir: neredeyse her güçlü teknoloji askeri amaçlar için kullanılabilir.

Ancak yapay zekâ hedefleme, orduların operasyonlarına dahil ettiği basit bir bileşen değil. Bu, bizzat karar verme mimarisinin kendisi; kimin öldürüleceğine ve neden öldürüleceğine karar veren şey. Tek bir sistem, insan istihbarat ekibinin 10 hedefi doğrulaması için gereken sürede on binlerce hedef üretebiliyorsa, soru özel şirketlerin ordulara tedarik sağlaması gerekip gerekmediği değil, herhangi bir yasal çerçevenin bununla temas halinde ayakta kalıp kalamayacağıdır.

Uluslararası hukukta hesap verebilirlik çerçevelerinden bahsediyoruz: ölümcül güç kullanma kararından, bu kararı yetkilendiren kişiye kadar uzanan hesap verebilirlik zinciri. Bir hesap verebilirlik çerçevesi, karar vericinin tanımlanabilir olmasını, gerekçelendirmesinin sonradan yeniden oluşturulabilir olmasını ve hukukun gerektirdiği süreç yükümlülüklerinin –orantılılık değerlendirmesi, doğrulama, önlem– yerine getirildiğinin gösterilebilmesini gerektirir.

Yapay zekâ hedeflemesi, bu koşulların her birini sistematik olarak yok eder. Sorumluluğun belirlenmesi, mühendisler, komutanlar, operatörler ve kurumsal tedarikçilerden oluşan bir zincir boyunca ortadan kalkar; her biri diğerini işaret edebilir. Akıl yürütme, hiçbir avukatın denetleyemeyeceği ve hiçbir mahkemenin sorgulayamayacağı bir olasılık puanına dönüşür. Süreç, bir makine önerisinin 20 saniyelik onayına indirgenir. Ve sistemi kuran ve satan şirketler, tamamen yasal çerçevenin dışında kalır, çünkü uluslararası insancıl hukuk devletler ve onların temsilcileri için tasarlanmıştır ve Palantir Cenevre Sözleşmelerine taraf değildir.

Hesap verebilirlik çerçevesi, yapay zeka savaşları tarafından sadece zorlanmakla veya test edilmekle kalmadı; yapısal olarak işlevsiz hale getirildi.

Teknoloji şirketleri değil, savunma müteahhitleri

Bu şirketlere teknoloji şirketleri demeyi bırakıp, oldukları gibi adlandırmaya başlamalıyız: savunma müteahhitleri.

En büyük yapay zeka firmaları, tesadüfen askeri bir müşteri bulmuş tarafsız altyapı sağlayıcıları değiller. Modern savaşın hedefleme mimarisine entegre ediliyorlar. Sistemleri öldürme zincirinin içinde yer alıyor, mühendisleri güvenlik izinlerine sahip, yöneticileri ise Silikon Vadisi'ni Pentagon'a bağlayan aynı döner kapıdan geçiyor.

Bu yapay zeka sağlayıcıları, askeri-sanayi kompleksinin en ön saflarında yer alıyor ve buna göre düzenlenmeleri gerekiyor. Raytheon ve Lockheed Martin gibi firmalar için ihracat kontrolleri, kongre denetimi, sorumluluk çerçeveleri ve tedarik koşullarını içeren açık bir hesap verebilirlik zinciri uygulanırken, askeri hedefleri seçen algoritmaları yazan şirketlere uygulanan zayıf düzenlemeler hiçbir zaman uygulanmamış, test edilmemiş veya yürürlüğe konmamıştır.

Bu bir gözden kaçırma değil. Bu, lobicilikle, "ticari" ve "savunma" ürünlerinin kasıtlı olarak birbirine karıştırılmasıyla ve yapay zekayı hâlâ savaş alanına tesadüfen girmiş bir tüketici teknolojisi olarak ele alan bir düzenleyici kültürle aktif olarak sürdürülen bir tercihtir. Palantir, 2024 yılında Washington'da lobicilik için yaklaşık 6 milyon dolar harcadı ve 2023'ün bir çeyreğinde Northrop Grumman'ı geride bıraktı. Faaliyet gösterdiği politika ortamını şekillendirmek için özel bir vakıf kurdu. Palantir, Anduril, OpenAI, SpaceX ve Scale AI'den oluşan konsorsiyum, kendi katılımcıları tarafından ABD hükümetine yeni nesil savunma yüklenicileri sağlamak üzere bir proje olarak tanımlandı. Bu şirketleri destekleyen risk sermayesi firmaları Andreessen Horowitz ve Founders Fund, iktidara yakınlık yoluyla etki yarattılar: danışma kurullarında eski üst düzey yetkililer, hükümet rollerinde dönüşümlü olarak görev alan ortaklar ve Pentagon'un ne kadar ve neye harcayacağına karar veren politika yapıcılara doğrudan erişim.

Yapay zekayı düzenlemeye yönelik bugüne kadarki en iddialı girişim olan AB Yapay Zeka Yasası, uluslararası insancıl hukukun daha uygun bir çerçeve olduğu gerekçesiyle askeri ve ulusal güvenlik uygulamalarını açıkça muaf tutuyor. Bu, dikkat çekici bir kısır döngü örneği: Bu sistemler tarafından sistematik olarak yok edilen hukuk dalı, onların düzenleyicisi olarak atanırken, onları gerçekten kısıtlayabilecek düzenleyiciler gözlerini kapatıyor.

Amerika Birleşik Devletleri'nde, 2025 Ulusal Savunma Yetkilendirme Yasası'nın yapay zekâ hükümleri askeri yapay zekâyı düzenlemiyor. Bunun yerine, kurumları daha fazla yapay zekâ benimsemeye yönlendiriyor. Pete Hegseth'in Ocak 2026'da yayınladığı yapay zekâ stratejisi, konuyu tamamen bir yarış olarak ele alıyor ve Pentagon'u savaş hızıyla hareket etmeye, yapay zekâyı ise ilk deneme alanı olarak kullanmaya yönlendiriyor. Düzenleyici kültür, teknolojiye ayak uydurmakta başarısız olmadı; aksine, bilerek denememeye karar verdi.

Şimdiye kadar, yapay zekâ destekli askeri yeteneklere yönelik gördüğümüz tek ciddi hükümet müdahalesi, kısıtlama veya hesap verebilirlik talep eden bir devletten değil, sistemlerin daha ölümcül hale getirilmesini talep eden ABD'den geldi. Kabul ettiğimiz hedef bu.

Baskı noktaları devam ediyor ve bunlar gerçek

Bu sistemleri tamamen yasaklamak, ilgili aktörlerin çoğunun uluslararası hukuku pek umursamadığı bir ortamda imkansızdır. Ancak baskı noktaları devam ediyor ve bunlar gerçek. Washington'da gelecekte yapay zekâ destekli askeri yetenekleri sonsuz bir Minab serisi üretmeden kullanmak isteyen herhangi bir hükümet, eleştirmenlere bir taviz olarak değil, yasa dışı bir aktör haline gelmemek için temel bir gereklilik olarak bir düzenleyici çerçeveye ihtiyaç duyacaktır. Aynı durum Avrupa'da da geçerlidir; İngiltere, tüm alanlarda sensörleri ve vuruş yeteneklerini birbirine bağlayan yeni bir yapay zekâ entegre hedefleme sistemine 1 milyar sterlinden fazla yatırım yapmıştır, Fransa'nın önde gelen yapay zekâ şirketi, otonom silah platformları geliştirmek için Alman bir savunma girişimiyle ortaklık kurmuştur ve Almanya, Ukrayna'da yapay zekâ güdümlü saldırı dronları konuşlandırmaktadır.

Bu sistemleri düzenlemek için bir fırsat var. AB'nin en belirgin araçları, askeri uygulamaları kasıtlı olarak muaf tutan Yapay Zeka Yasası aracılığıyla değil, ticari ve savunma pazarları arasında hareket eden çift kullanımlı sistemlere yönelik ihracat kontrolleri ve tedarik koşulları aracılığıyla mevcut. Uluslararası mahkemeler de kapıları açmaya başlıyor: Uluslararası Adalet Divanı'nın Filistin haklarına ilişkin danışma görüşü, yasadışı saldırılarda kullanılan sistemleri tedarik eden şirketlerin, uluslararası hukuku ciddiye alan yargı bölgelerinde potansiyel sorumluluk riskiyle karşı karşıya kalacağı bir çerçeve oluşturdu. Ve yapay zeka firmalarının hükümetlere sadece müşteri olarak değil, aynı zamanda sınır yapay zekasının gerektirdiği ve hiçbir şirketin yalnızca ticari gelirlerle sürdüremeyeceği bilgi işlem gücü, enerji ve fiziksel altyapının sağlayıcısı olarak da ihtiyaçları var. Bu bağımlılık, bunu kullanmaya istekli devletlere, düzenlenmeyi tercih etmeyen şirketler üzerinde gerçek bir kaldıraç sağlıyor. Soru şu ki, harekete geçme araçlarına sahip herhangi bir hükümet, bir sonraki Minab'dan önce, hareketsizliğin maliyetinin çok yüksek olduğuna karar verecek mi?

Düzenlemenin nasıl olması gerektiği, uygulanması zor olsa bile, nispeten basittir. Hedeflemede kullanılan yapay zeka sistemleri açıklanabilir olmalıdır – olasılık puanıyla değil, bir avukatın denetleyebileceği bir mantıkla. Yapay zeka destekli kampanyaların kümülatif sivil maliyeti bir bütün olarak değerlendirilmelidir. Ve operatörde duran sorumluluk, silahlı çatışmalarda kullanılmak üzere bilerek şeffaf olmayan sistemler üreten ve satan şirketlere kadar tedarik zincirini kapsamalıdır. Bunlar yeni talepler değil. Bunlar, algoritmik hedefleme çağında savaş hukukunun bir anlam ifade etmesi için asgari koşullardır.

Bu arada, sis prosedürü işliyor ve savaşın geleceğini belirlemeye başlıyor. Ancak karanlığa ateş eden askerler en azından o anın içindeydiler. Onların yerini alan yapıları üreten şirketler ise bunu Palo Alto'dan, hiçbir kişisel risk almadan, yasal bir yükümlülük altına girmeden ve tekrar yapma konusunda her türlü teşvikle yapıyorlar.